La startup británica, financiada por Microsoft y valorada en 1.500 millones de dólares, simulaba automatización con mano de obra en India mientras promocionaba una inteligencia artificial que no existía

Builder.ai era presentada como una de las startups más prometedoras del sector tecnológico. Su propuesta parecía revolucionaria: desarrollar aplicaciones a pedido mediante inteligencia artificial, sin necesidad de escribir una sola línea de código. La empresa, fundada en Londres, afirmaba que bastaba con describir qué se quería para que una IA llamada “Natasha” hiciera el resto. Con esa promesa logró atraer a inversores de peso, entre ellos Microsoft y el fondo soberano de Qatar. Sin embargo, todo era una fachada.

Durante años, la compañía ocultó que detrás de su aparente automatización había en realidad cientos de personas trabajando. Según revelaciones recientes, al menos 700 programadores en India eran quienes verdaderamente construían las aplicaciones solicitadas por los clientes. Las tareas llegaban a través de instrucciones estandarizadas desde la sede central y se repartían de forma manual. Nada de lo que hacía Natasha era automático, ni mucho menos inteligente.

El escándalo estalló en mayo de 2025, cuando la empresa empezó a mostrar señales de inestabilidad financiera. Algunas voces internas, entre ellas ex empleados, comenzaron a hablar. Filtraciones posteriores confirmaron lo que muchos empezaban a sospechar: la inteligencia artificial nunca existió. Lo que sí había era una campaña de marketing bien pensada, presentaciones cuidadosamente editadas y una narrativa que encajaba perfecto con la moda del momento.

Mientras tanto, los productos seguían saliendo y los clientes seguían pagando, convencidos de estar usando tecnología de punta. El modelo de negocio de Builder.ai, más que innovador, resultó ser una versión maquillada de los viejos esquemas de tercerización: personas trabajando desde la sombra, pero con una etiqueta de “IA” como sello de prestigio.

Medios especializados como WIRED y Bloomberg recogieron el caso y aportaron nuevos datos. Algunos desarrolladores declararon que las herramientas internas que usaban estaban lejos de ser inteligentes. Más bien se trataba de plataformas simples de gestión de tareas. Incluso las métricas de eficiencia y automatización, que se compartían con los inversores, estaban infladas o directamente manipuladas.

Este episodio vuelve a poner en primer plano la necesidad de revisar con lupa los discursos en torno a la inteligencia artificial. En un contexto de entusiasmo global por las tecnologías generativas, muchas empresas se apresuran a subirse a la ola, aunque no cuenten con soluciones reales. Lo ocurrido con Builder.ai no solo afecta a sus inversores o clientes, sino que golpea la credibilidad de todo un sector.

Para muchos, se trata del primer gran fraude de la era de la IA. Uno que no se dio por un error técnico, sino por una decisión consciente de esconder la verdad. Y también una advertencia: no todo lo que dice ser inteligente, lo es.

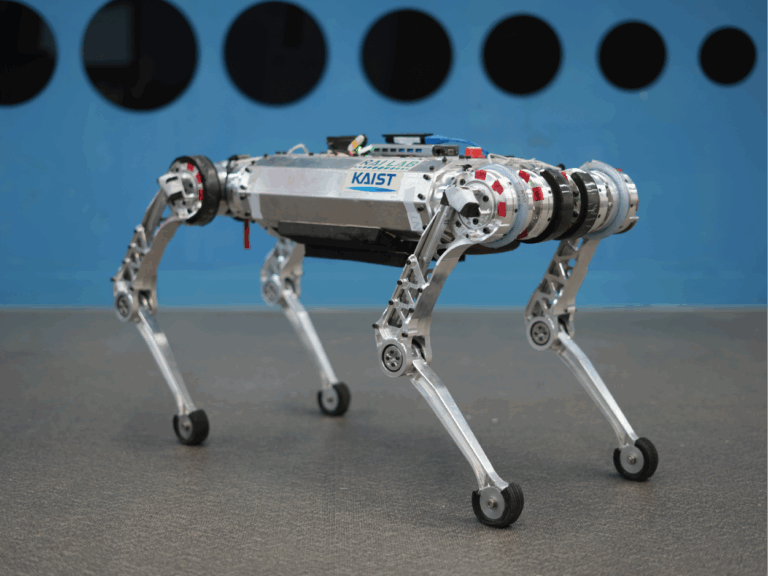

- Corea del Sur logra que un robot cuadrúpedo haga parkour en fábricas con total autonomía - junio 9, 2025

- Builder.ai prometía programar con IA, pero usaba 700 programadores humanos en secreto - junio 8, 2025

- Carlos III saluda a Milei y destaca los lazos históricos entre Argentina y Reino Unido - mayo 26, 2025